2025年AI大転換まとめ:生成AIとLLMの新潮流を徹底解説

- RLVRでAIが自ら『考える』時代が到来、学習効率が劇的に変化

- LLMは『新しいOS』としてインフラとエージェントを再定義

- ローカルAIやマルチモーダルインターフェースが実務に浸透しつつある

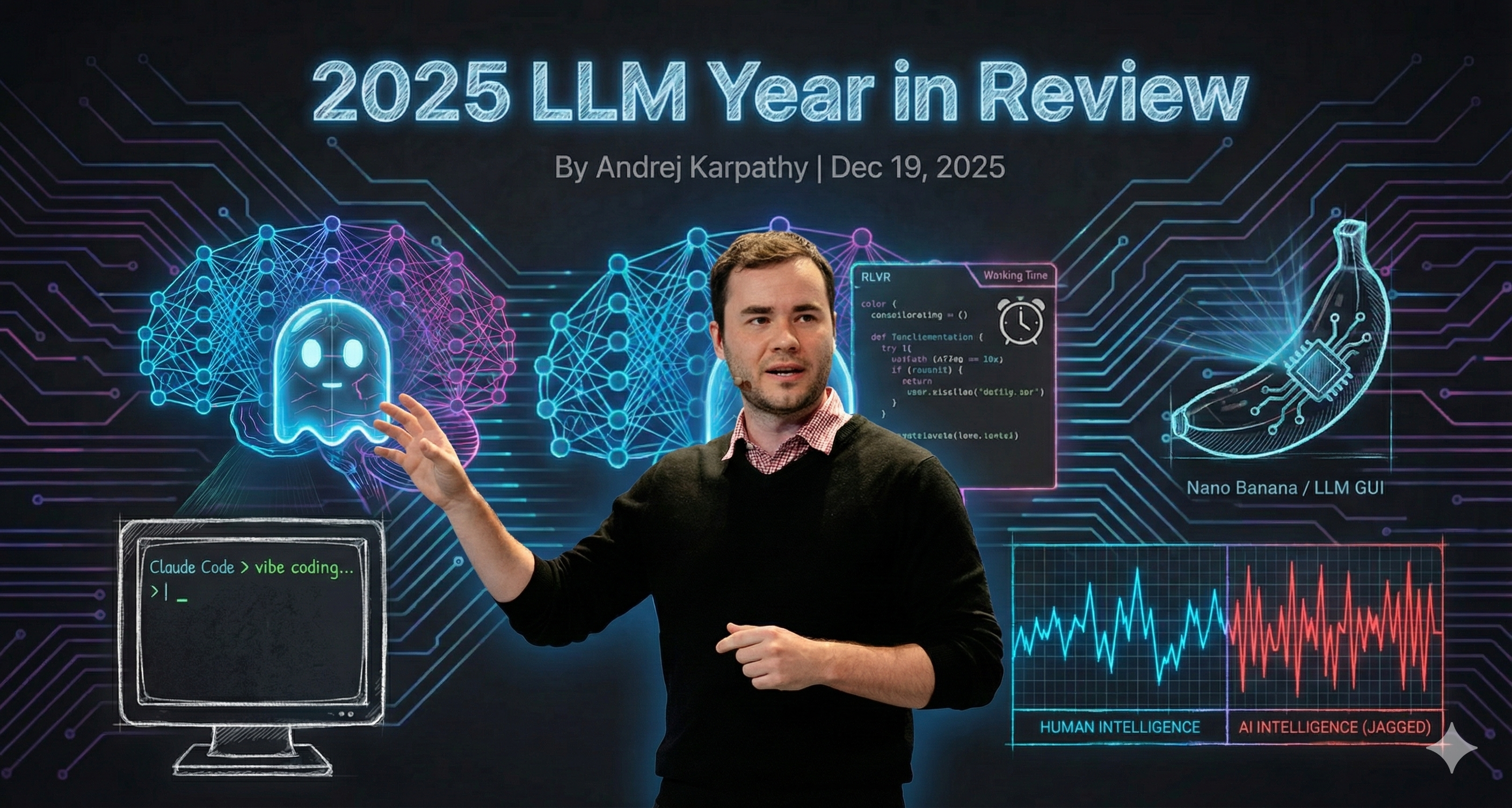

こんにちは!テックブロガーの○○です。最近、OpenAI の元共同創業者である Andrej Karpathy が「2025 年度まとめ」を公開し、AI 業界の今とこれからを大胆に語っていました。彼の洞察は、生成AI・LLM が単なるツールから「新しいオペレーティングシステム」へと変貌させる過程を示していて、まさに私たちが日々体感している変化と合致しますよね。この記事では、Karpathy の主張を噛み砕きつつ、日本の読者がすぐに活用できるポイントを整理してみました。

1. RLVR:AI が自ら『考える』新しい学習法

従来の大規模言語モデル(LLM)は、事前学習 → 監督微調整(SFT) → 人間フィードバック強化学習(RLHF)という三段階で育てられてきました。2025 年に登場した RLVR(Reinforcement Learning from Verifiable Rewards) は、この流れに革命をもたらします。

RLHF では人間が答えを評価してスコアを付けますが、評価が主観的で遅く、スケールしにくいという課題がありました。一方、RLVR は「正解が明確に検証できる」タスク(例:数学問題やコードコンパイル)を大量に与え、AI が自動で正誤を判定しながら学習します。結果として、モデルは自ら問題を分解し、途中で『チェック』するという高度な推論パターンを獲得しました。

OpenAI の o1 系列や DeepSeek R1 が示すように、RLVR による自己対話は「思考時間」を伸ばす新たなノブとなり、モデルサイズは変わらなくても性能が飛躍的に向上します。これが今年の最大の転換点と言えるでしょう。

2. LLM は新しい OS:インフラとエージェントの再定義

Karpathy は LLM を「新しいオペレーティングシステム」と表現しています。なぜなら、LLM は単なるテキスト生成エンジンではなく、コンテキストウィンドウ(メモリ)と推論算力(CPU)を動的にスケジューリングし、さまざまなアプリケーションを統合する役割を担うからです。

この視点から見ると、エージェント(Agent)やツールチェーンは OS 上のアプリケーションに相当します。たとえば Cursor は「コード編集の包工頭」として、複数の LLM を裏で連携させ、タスクを細分化・最適化します。また、Claude Code のようにローカル環境に常駐するエージェントは、クラウドだけに依存しない「オンデバイス AI」の実装例です。

この流れは、AI インフラ(訓練・推論)の設計思想を「大規模クラウド」から「分散・ハイブリッド」へとシフトさせ、ハードウェア側でも高速な推論チップや低遅延ネットワークが求められるようになります。

3. マルチモーダルと『顔』を持つ AI:Nano Banana の登場

テキストだけの対話は、いわば 80 年代の DOS 端末です。2025 年、Google Gemini の「Nano Banana」プロジェクトが示すように、AI は画像・動画・音声といったマルチモーダル情報を同時に扱い、ユーザーに「視覚的な答え」を提供し始めました。

具体例として、コードエラーのスクリーンショットを投げると、AI が自動で図解付きのデバッグ手順を生成したり、デザイン案のワイヤーフレームを即座に描き出したりします。これにより、エンジニアやデザイナーは「文字を読む」作業から解放され、直感的に結果を得られるようになるのです。

Vibe Coding:感覚でコードを書く時代

さらに Karpathy がツイートで拡散した「Vibe Coding」は、プログラミングのハードルを根本から下げる概念です。コードの文法を覚える必要はなく、実現したい「意図」や「雰囲気」を自然言語で指示すれば、AI が即座に実装してくれます。これにより、非エンジニアでもプロトタイプを数クリックで作成でき、ソフトウェア開発の民主化が加速します。

日本への影響・示唆

日本企業がこの波に乗り遅れないために、今すぐ取り組むべきポイントは次のとおりです。

- 自社データを活用した RLVR パイプラインを構築し、業務プロセスの自動化や高度な意思決定支援を実現する。

- LLM を「OS」と捉えて、社内ツールや SaaS プロダクトを LLM 中心のアーキテクチャへ再設計する。特にエージェント連携やマルチモーダル UI は、顧客体験向上の鍵となります。

- ローカル AI(Claude Code など)を導入し、機密情報や開発環境をクラウドに依存しない形で保護しつつ、開発スピードを向上させる。

- Vibe Coding の概念を社内教育に取り入れ、プログラミング未経験者でもアイデアを形にできる環境を整える。

これらを実行すれば、生成AI と LLM がもたらす「新しい OS 時代」を日本国内でもリードできるはずです。さあ、AI が「天才」でも「ちょっとしたバカ」でもあるこの時代、私たちも一緒に学び、実装し、未来を創っていきましょう!